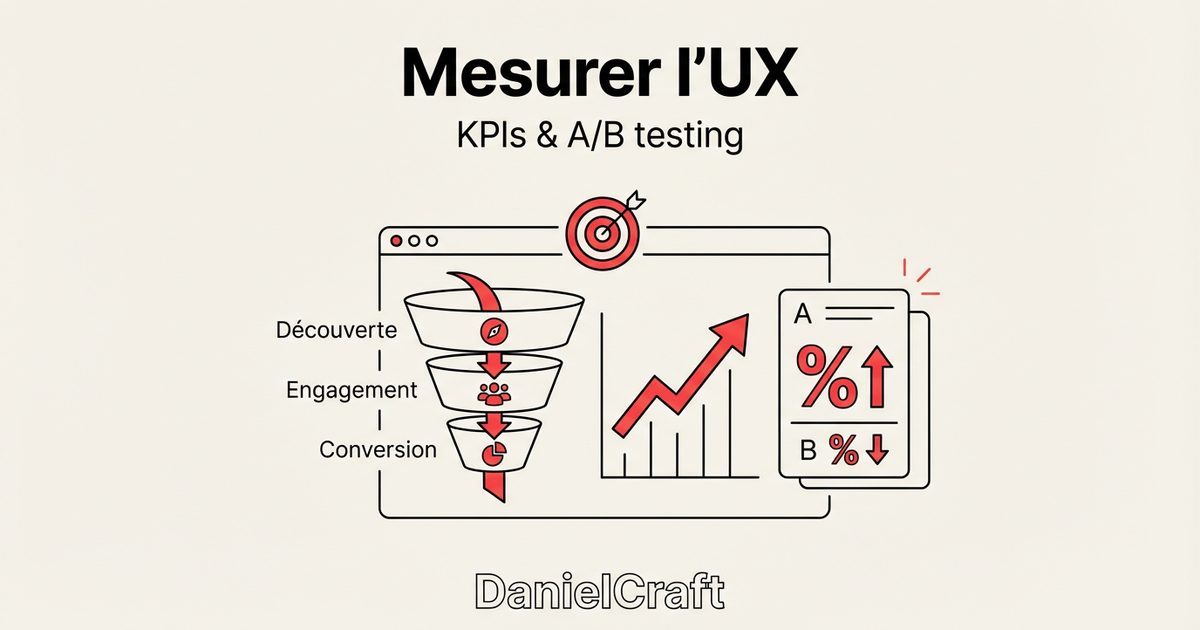

Mesurer l’UX : KPIs, analytics, tests et A/B testing (sans vanity metrics)

Améliorer l’UX sans mesure, c’est possible… jusqu’à un certain point.

Sans données, tu ne sais pas si :

- la friction est réelle ou juste “ressentie”

- une amélioration marche pour 10 % ou pour 90 %

- tu as déplacé le problème ailleurs

Mais attention : mesurer n’est pas empiler des dashboards. L’objectif est de prendre de meilleures décisions.

1) Les pièges : vanity metrics et fausses certitudes

Vanity metrics typiques :

- pages vues sans contexte

- temps passé (parfois signe de friction)

- “engagement” flou

Question clé :

“Quelle action représente une réussite utilisateur ?”

2) Les métriques UX vraiment utiles

Pour un parcours, mesure :

- taux de complétion (conversion)

- temps pour réussir (time-to-success)

- drop-off par étape (où ça casse)

- erreurs (fréquence, type)

- retours arrière (hésitation)

Et si tu peux :

- support tickets liés au parcours

- NPS/CSAT ciblé après l’action (pas global)

3) Instrumentation minimale : 5 événements bien choisis

Tu n’as pas besoin de 200 events.

Pour un funnel simple :

funnel_startstep_1_completedstep_2_completedsuccesserror(avec code / type)

Ajoute :

source(mobile/web)variant(si A/B)latency_bucket(si perf)

L’idée : diagnostiquer sans espionner.

4) Funnels et cohortes : la base de l’analyse

- Funnel : où les gens sortent

- Cohorte : comment le comportement évolue dans le temps (nouveaux vs anciens)

Souvent, l’amélioration UX n’est pas “+10 % global” mais :

- +25 % sur mobile

- +5 % sur desktop

Sans segmentation, tu rates l’essentiel.

5) Quali + quanti : le duo gagnant

Les chiffres disent où ça casse.

Les tests utilisateurs disent pourquoi.

Une méthode efficace :

- repérer un drop-off

- faire 5 tests ciblés sur cette étape

- corriger

- re-mesurer

6) A/B testing : quand c’est utile (et quand ça ne l’est pas)

Un A/B test est utile quand :

- tu as du trafic suffisant

- l’impact attendu est mesurable

- tu contrôles les variantes (pas 15 variables)

Inutile (voire dangereux) quand :

- le problème est un bug UX évident

- le trafic est faible (tu concluras au hasard)

Avant un A/B, fais souvent un test utilisateur : c’est plus rapide et plus “explicatif”.

7) Exemple de KPIs “propres” par type de feature

Onboarding

- activation (action clé atteinte)

- temps pour activation

- support lié à l’inscription

Formulaire

- taux de complétion

- erreurs / champ

- abandon par étape

Checkout

- conversion

- erreur paiement

- latence

Conclusion

Mesurer l’UX, ce n’est pas “tout tracker”.

C’est choisir des indicateurs qui reflètent la réussite utilisateur, et boucler vite entre :

- observation (quanti)

- compréhension (quali)

- amélioration (design/dev)

- validation (mesure)

Si tu fais ça, tu progresses régulièrement — et tu évites les débats sans fin.